هوش مصنوعی قاتل کتاب ها: حقیقتی تلخ!

رکنا: شرکت «آنتروپیک» با استخدام سرپرست پیشین پروژه اسکن کتاب های گوگل، میلیون ها کتاب را برای آموزش هوش مصنوعی خود جمع آوری کرد و از تکنیک های خاصی برای دور زدن محدودیت های حقوقی استفاده کرد.

به گزارش رکنا، شرکت «آنتروپیک» میلیونها کتاب را قربانی کرد تا « هوش مصنوعی » خود را توسعه دهد.

روش عجیب آموزش مدلهای هوش مصنوعی

یکی از پرسشهای اساسی این روزها که در میان بحثهای مختلف درباره نابودی تدریجی هنرها توسط صنعت «هوش مصنوعی» مطرح میشود، این است که چگونه «آنتروپیک» دادههای لازم برای آموزش مدل «کلود» (Claude) را گردآوری کرده است.

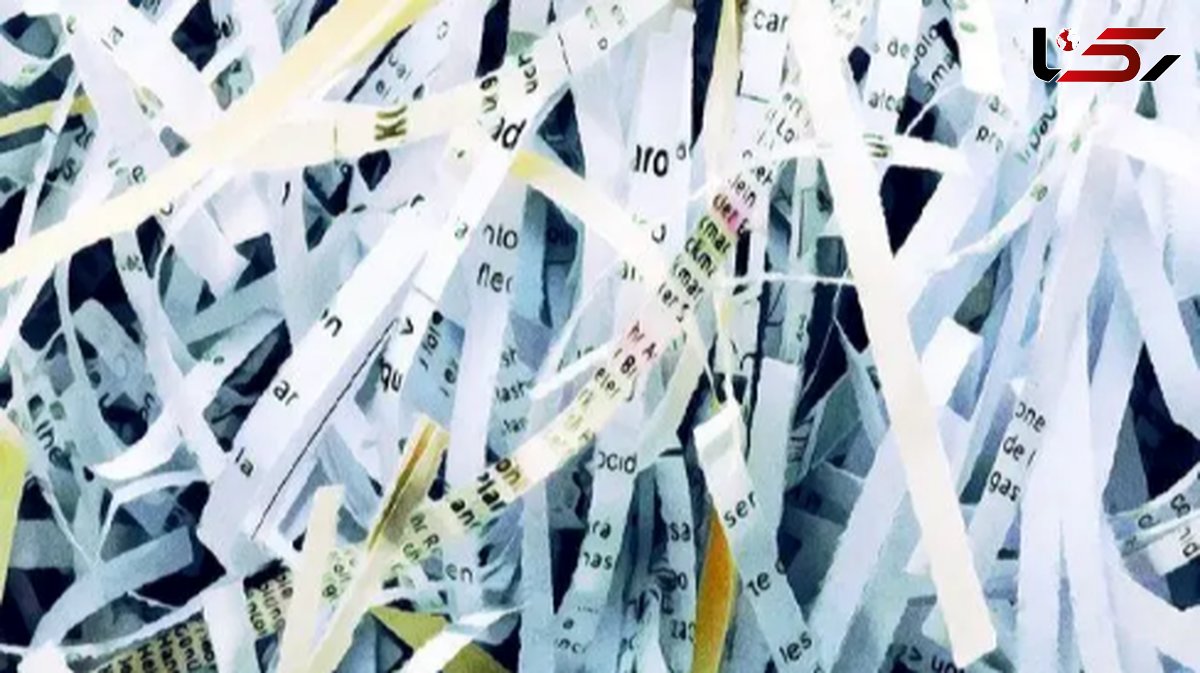

اسکن و نابودی میلیونها صفحه کتاب

مطابق گزارش فیوچریسم، این استارتآپ که از طرف گوگل حمایت میشود، تنها به تقلید از میلیونها کتاب دارای حق نشر اکتفا نکرد. بلکه صفحات کتابها را از جلد جدا کرده، آنها را اسکن نموده تا نسخههای دیجیتال ایجاد کند و سپس تمامی نسخههای چاپی را از بین برد. این روش در اصل از سوی هوش مصنوعی، به معنای «بلعیدن» کتابها بوده است.

تصمیم دادگاه و مشروعیت قانونی

این فرآیند در دادگاه فاش شد. قاضی اعلام کرد که «آنتروپیک» میتواند مدلهای زبانی بزرگ (LLM) خود را بر اساس کتابهایی که به صورت قانونی خریداری شدهاند، حتی بدون اخذ اجازه مستقیم از نویسندگان، آموزش دهد.

البته «آنتروپیک» تنها شرکتی نیست که چنین اقدامی را انجام داده است، اما به دلیل وسعت عظیم عملیاتش مورد توجه ویژه قرار گرفت.

استفاده از قانون «قاعده اولین فروش»

این شیوه استناد به قوانین حقوقی «قاعده اولین فروش» بوده است که به خریداران اجازه میدهد با کالایی که خریداری کردهاند هرگونه استفادهای داشته باشند، بدون اینکه به مداخله ناشر یا حقوقدان نیاز باشد. با این حال، اقدامات اخیر شرکتهای «هوش مصنوعی» باعث ایجاد شک و شبهههای اخلاقی شدهاند.

استخدام کارشناس سابق اسکن کتابهای گوگل

شرکت «آنتروپیک» در بهمن ماه ۱۴۰۲، «تام تروی» (Tom Turvey)، مسئول پیشین پروژه اسکن کتابهای گوگل را استخدام کرد تا بتواند تمامی کتابهای جهان را بدون چالش حقوقی جمعآوری کند. «تروی» با خرید کتابهای فیزیکی، موجب محافظت قانونی این شرکت تحت قانون «قاعده اولین فروش» شد و دیگر نیازی به دریافت مجوز نداشت.

صرفهجویی در هزینهها با نابودی فیزیکی

جدا کردن صفحات کتابها فرآیند اسکن را سادهتر و ارزانتر میکرد؛ زیرا نسخههای اسکنشده صرفاً به صورت داخلی استفاده شده و پس از آن دور ریخته میشدند. این کار از نظر قانونی کاملاً مجاز بوده است.

اقدامات غیراخلاقی اولیه

با این حال، مسیر آغازین «آنتروپیک» کاملاً غیراخلاقی بوده است. این شرکت میلیونها کتاب را به صورت غیرقانونی دانلود کرده و از آنها برای آموزش مدلهای «هوش مصنوعی» خود استفاده کرده است. این روش مشابه فعالیتهای شرکت «متا» (Meta) بوده که به تازگی توسط گروهی از نویسندگان به دادگاه کشیده شده است.

روشهای جایگزین و دقیقتر

بسیاری از آرشیوها و مؤسسات علمی روشهای پیشرفتهای برای اسکن گروهی کتابها طراحی کردهاند که نیازی به نابودی یا تغییر فیزیکی کتابها ندارد. با این وجود، به دلیل هزینههای پایینتر چنین رویکردهای غیرمستقیم، صنعت «هوش مصنوعی» همچنان از راهحلهای کمهزینه و البته غیراخلاقی استفاده میکند.

به این ترتیب، نابودی کتابها و آسیب به نویسندگان، به عنوان هزینهای کوچک برای پیشرفت غولهای فناوری در نظر گرفته شده و توجه کمی به جنبههای اخلاقی و فرهنگی این اقدامات صورت گرفته است.

ارسال نظر