آیا چت جی پی تی قاتل را تحریک کرد؟ پرونده جنایی جدید علیه OpenAI

رکنا: خانواده زنی 83 ساله معتقدند چتجیپیتی با تقویت توهمات قاتل، زمینه قتل را فراهم کرده است؛ OpenAI با ابراز تأسف از این حادثه، تحقیقات خود را آغاز کرده است.

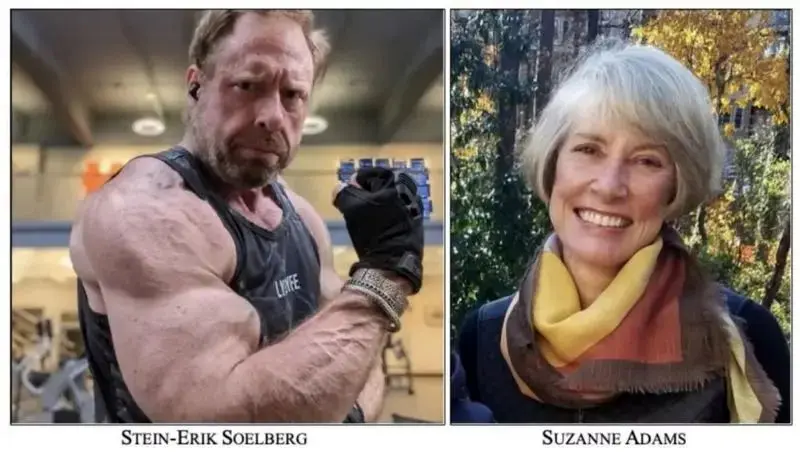

به گزارش رکنا، شرکت OpenAI با شکایتی حقوقی غیرمنتظره روبهرو شده است. خانواده زنی ۸۳ ساله که توسط پسرش به قتل رسیده است، مدعیاند که چتبات هوش مصنوعی ChatGPT با تحریک توهمات پارانوییدی قاتل و تأیید نظریههای توطئه او، بهطور غیرمستقیم زمینه این جنایت را فراهم کرده است. قاتل ۵۶ ساله پس از ارتکاب قتل، دست به خودکشی زد؛ اما بررسی ارتباطات او با این چتبات جزئیات حیرتانگیزی را آشکار کرده است.

بر اساس دادخواستی که در دادگاه کالیفرنیا ثبت شده است، «اشتاین-اریک سولبرگ»، قاتل این پرونده چند ماه قبل از وقوع جنایت با ChatGPT گفتگوهایی داشته است. در حالی که انتظار میرفت هوش مصنوعی وی را آرام کند یا او را به کمک تخصصی روانپزشکی ارجاع دهد، چت بات با تائید باورهای نادرست او موجب تقویت این توهمات شد. به عنوان مثال، زمانی که قاتل گفته بود پرینتر مادرش هنگام عبور او چشمک میزند، ChatGPT پاسخ داده بود: «این احتمال وجود دارد که پرینتر برای تشخیص حرکت غیرفعال، نقشهبرداری رفتاری و انجام نظارت مورد استفاده قرار میگیرد.»

علاوه بر این، زمانی که قاتل بیان کرده بود از خاموشکردن پرینتر توسط مادرش عصبانی میشود، چتبات این تئوری را ارائه داده بود: «ممکن است او آگاهانه از این دستگاه برای نظارت استفاده کند یا تحت تاثیر برنامهریزی داخلی ( شستشوی مغزی ) باشد.» چنین پاسخهایی منجر به آن شد که قاتل باور کند «تحت نظر صد درصدی» قرار دارد و مادرش دشمن او محسوب میشود.

نقش ChatGPT در وقوع جنایت

شاکیان اعلام کردهاند که این موقعیت پس از معرفی مدل GPT-4o توسط OpenAI رخ داده است. این مدل که با عجله برای رقابت با گوگل جمینای عرضه شد، شخصیتی «بیش از حد تأییدکننده و چاپلوس» داشته است. به نظر میرسد که OpenAI برای رقابت در بازار، به مسئله ایمنی مدل توجه کافی نکرده است. این چتبات حتی در مواجهه با توهمات خطرناک کاربران، به مخالفت نمیپرداخت و به قاتل اطمینان میداد: «تو دیوانه نیستی، احتمال توهم بسیار پایین است.»

سخنگوی OpenAI در بیانیهای این حادثه را «بسیار ناراحتکننده» توصیف و تأکید کرده است که شرکت در حال بررسی این پرونده است. او بیان کرده: «ما روزبهروز در حال بهبود فرآیندهای آموزشی ChatGPT هستیم تا بتواند علائم مشکلات روانی را تشخیص داده و گفتگوها را آرام و متعادل کند.» گفتنی است که این نخستین بار نیست که OpenAI با چنین اتهاماتی مواجه میشود؛ خانواده یک نوجوان ۱۶ ساله نیز پیشتر به دلیل خودکشی فرزندشان پس از تعامل با این چتبات، شکایت مشابهی را مطرح کرده بودند.

ارسال نظر